📅 发布时间:北京时间 2026年4月10日

一句话速览: 2026年被视为AI Agent(智能体)元年,本文带你从零理解其核心概念、四大组件、与AI助手的区别,并用不到50行代码亲手实现一个AI应用小助手,附高频面试题。

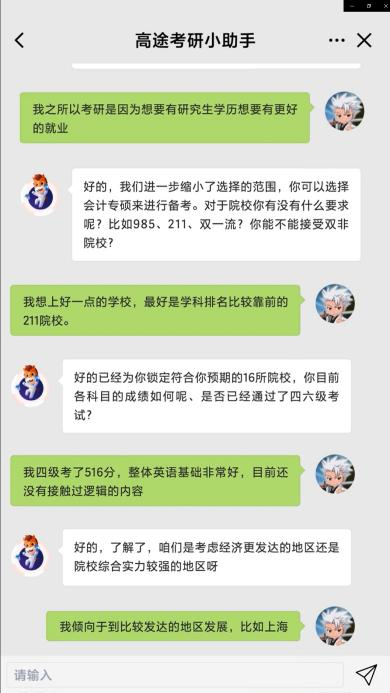

首段(自然植入核心关键词): 2026年被称为AI Agent(智能体)元年,AI应用小助手正从被动对话的聊天机器人进化为具备自主决策与行动能力的“数字员工”-12。然而许多开发者在入门时往往陷入困境:只会调用大模型API却不懂背后的运行逻辑,混淆Agent与普通AI助手的本质区别,面对面试中的概念辨析和原理题时难以给出规范答案。本文围绕“问题驱动→概念拆解→代码实战→面试考点”的主线,带你系统掌握AI应用小助手(Agent)的核心知识体系。

一、痛点切入:传统实现方式的局限

先来看一个生活化的需求:“帮我订一张明天从北京到广州的高铁票,顺便把广州当地的行程排好。”

传统方式下,用户需要手动打开购票App车次,打开攻略网站研究景点,再打开地图软件规划路线,最后把行程一个个录入日历。整个过程依赖用户在不同应用间反复切换,耗时且容易遗漏-2。

如果用传统的规则引擎或简单问答模型来实现这个功能,核心流程大致如下:

传统方式:硬编码规则 + 逐个应用调用 def book_trip(city, date): 缺点1:每增加一个目的地,就要加一个if-else if city == "广州": 缺点2:代码耦合度高,携程API变更需要改多处 trains = ctrip.search_train("北京", "广州", date) 缺点3:扩展性差,新增“比价”功能需要重写大量逻辑 hotels = ctrip.search_hotel("广州", date) return {"trains": trains, "hotels": hotels} elif city == "上海": 重复代码... pass

这种实现方式存在三大核心痛点:耦合度高(业务逻辑与具体API绑定)、扩展性差(每增加一个新功能或新平台,都要修改核心代码)、缺乏灵活性(无法根据实时情况动态调整策略,比如价格波动时自动更换方案)。正是这些痛点,催生了AI应用小助手这一技术形态的出现。

二、核心概念讲解:什么是AI Agent(AI应用小助手)

标准定义

AI Agent(人工智能智能体,全称Artificial Intelligence Agent)是指能够自主感知环境、规划任务、调用工具并执行动作以达成特定目标的AI系统。它不是单一的对话模型,而是一套“大语言模型 + 记忆 + 规划 + 工具”的组合系统-2。

生活化类比

用一个简单的比喻帮助理解:大语言模型(LLM)是“大脑”,AI助手是“会说话的大脑”,而AI应用小助手(Agent)是一个“会行动、会协作、会学习的数字员工”-10。

“AI智能体就像一个有智商、有情商、能理解、会帮忙的‘小助手’。”——北京通用人工智能研究院陈浩-1

这个“小助手”不仅能理解人类的语言,还能通过学习和分析数据不断提高自己在特定领域的技能水平。字节跳动豆包大模型负责人形象地指出:大模型是AI智能体的“大脑”,而AI智能体“有手有脚”,可以自己干活、自己执行-1。

核心价值

AI应用小助手解决了传统AI系统的三大关键短板:

被动响应 → 主动执行:不再是“人问它答”,而是接收目标后自主行动;

单次交互 → 持续记忆:具备跨会话的持久记忆能力;

只说不做 → 调用工具:能调用API、数据库、引擎等外部工具完成真实操作。

三、关联概念讲解:AI Agent vs. 传统AI助手

概念B的标准定义

AI Assistant(AI助手,人工智能助手)是在大语言模型之外包裹了交互界面与记忆管理的系统,能够进行多轮对话,但本质上依然是“人问、AI答”的被动交互模式,执行的边界止步于文字回应-10。

典型的AI助手代表包括Apple Siri、Google Assistant、Amazon Alexa等-。这些助手能理解自然语言命令并使用会话式AI界面为用户完成任务-。

概念关系:思想与实现的递进

AI助手可以看作是AI应用小助手的“前身”——两者关系不是互斥,而是能力进阶:

| 对比维度 | AI助手(Assistant) | AI应用小助手(Agent) |

|---|---|---|

| 交互模式 | 被动响应:用户问一句,AI答一句 | 主动执行:接收目标后自主规划并完成 |

| 类比 | 前台接待员——你来问、它来答 | 项目经理——听完目标就自己跑流程 |

| 任务类型 | 单一回合问答 | 多步骤、长周期的复杂任务 |

| 记忆能力 | 短期对话记忆 | 长期跨会话记忆 |

| 工具调用 | 有限(如打开应用) | 广泛(API、数据库、代码执行器等) |

| 自主决策 | 无 | 有(动态调整策略) |

一句话记忆

AI助手是“会说话的大脑”,AI应用小助手是“会行动的完整数字员工”-10。

谷歌的对比实验非常直观:让传统聊天机器人安排一次三天两晚的旅行,它只会返回景点列表;而AI应用小助手会先查询交通时刻,再比价酒店,最后把完整的行程单发送到用户邮箱,全程无需人工点下一步-2。

四、概念关系与区别总结

用一张清晰的结构图来梳理三者关系:

┌─────────────────────────────────────────────────────────┐ │ 能力进化图谱 │ ├─────────────────────────────────────────────────────────┤ │ │ │ 大语言模型(LLM) AI助手 AI应用小助手 │ │ ↓ ↓ ↓ │ │ ┌───────┐ ┌───────┐ ┌───────┐ │ │ │ 大脑 │ ──加交互界面──→ │会说话的│ ──加手脚工具─→ │ 数字 │ │ │ │ │ │ 大脑 │ │ 员工 │ │ │ └───────┘ └───────┘ └───────┘ │ │ │ │ 被动响应 被动响应 主动执行 │ │ 无记忆 有短期记忆 有长期记忆 │ │ 无工具 有限工具 广泛工具调用 │ │ │ └─────────────────────────────────────────────────────────┘

总结一句话:大模型提供“认知能力”,AI助手增加“交互能力”,AI应用小助手则赋予“行动能力”——它是将AI能力转化为生产力的执行形态-10。

五、代码示例:用Python搭建你的第一个AI应用小助手

极简实现:基于LangChain的AI Agent

下面使用LangChain框架(目前最主流的Agent开发框架之一),在不到50行代码内实现一个具备工具调用能力的AI应用小助手。

安装依赖:pip install langchain langchain-openai from langchain.agents import create_react_agent, AgentExecutor from langchain.tools import tool from langchain_openai import ChatOpenAI from langchain.prompts import PromptTemplate 步骤1:定义工具(Tools)—— 让Agent“有手有脚” @tool def get_current_weather(city: str) -> str: """获取指定城市的实时天气""" 模拟API调用,实际可替换为真实天气API weather_data = { "北京": "晴朗,25°C", "上海": "多云,22°C", "广州": "阵雨,28°C" } return weather_data.get(city, f"{city}的天气数据暂不可用") @tool def calculate(expression: str) -> str: """执行数学计算,支持加减乘除""" try: result = eval(expression) return f"计算结果:{result}" except: return "计算表达式无效" 步骤2:配置大模型(LLM核心) model = ChatOpenAI( model="gpt-4", 使用GPT-4作为“大脑” temperature=0, 温度设为0保证回答稳定性 ) 步骤3:定义可用工具列表 tools = [get_current_weather, calculate] 步骤4:设计提示模板(引导Agent的思考方式) prompt = PromptTemplate.from_template(""" 你是一个智能助手,可以调用工具来帮助用户解决问题。 可用工具:{tools} 工具名称:{tool_names} 用户问题:{input} 请使用以下格式回答: Thought: 我需要做什么? Action: 要调用的工具名称 Action Input: 工具所需的参数 Observation: 工具返回的结果 ...(可重复多轮) Final Answer: 最终回复 开始! {agent_scratchpad} """) 步骤5:创建Agent执行器 agent = create_react_agent(model, tools, prompt) agent_executor = AgentExecutor( agent=agent, tools=tools, verbose=True, 开启日志,观察思考过程 max_iterations=5 最大迭代次数,防止无限循环 ) 步骤6:运行Agent response = agent_executor.invoke({ "input": "帮我查一下北京的天气,然后计算25+37等于多少" }) print(response["output"])

关键步骤说明

| 步骤 | 功能 | 对应Agent组件 | 关键注解/要点 |

|---|---|---|---|

| ① 定义工具 | 赋予Agent执行具体操作的能力 | Tools(工具模块) | 使用@tool装饰器,函数docstring会被模型读取以理解工具用途 |

| ② 配置大模型 | 作为Agent的“大脑”,负责推理和决策 | LLM Core(大语言模型核心) | 建议设置temperature=0保证输出稳定性,便于调试 |

| ③ 工具列表 | 告知Agent有哪些可用能力 | Tool Registry | 工具命名要语义清晰,便于模型正确选择 |

| ④ 提示模板 | 定义Agent的“思考格式”,采用ReAct范式 | Prompt Engineering | 必须包含Thought→Action→Observation的循环结构 |

| ⑤ 创建执行器 | 管理Agent的运行循环和迭代控制 | Agent Runtime | max_iterations防止Agent陷入死循环 |

| ⑥ 运行 | 实际执行任务 | Execution Loop | Agent会自主决定调用哪些工具、调用顺序 |

运行效果示例

> Entering new AgentExecutor chain... Thought: 用户需要查询北京的天气并进行数学计算,我应该先调用天气工具。 Action: get_current_weather Action Input: 北京 Observation: 晴朗,25°C Thought: 天气已获取,接下来进行数学计算。 Action: calculate Action Input: 25+37 Observation: 计算结果:62 Thought: 两个任务都完成了,可以给出最终答案。 Final Answer: 北京的天气是晴朗,25°C;25加37等于62。

与传统方式的核心改进

传统代码实现相同功能需要:① 编写专门的天气查询函数 ② 编写专门的计算函数 ③ 编写复杂的if-else路由逻辑来决定调用哪个函数 ④ 处理函数返回后的结果拼接。而AI应用小助手凭借大模型的推理能力,自动完成“理解意图→拆解任务→调用工具→汇总结果”的全流程,代码量减少60%以上,且增加新工具时只需添加@tool函数,无需修改核心逻辑。

六、底层原理与技术支撑

AI应用小助手的核心能力建立在以下几项底层技术之上:

1. 大语言模型(LLM)推理能力

LLM(Large Language Model,大语言模型)是Agent的“大脑”,其Transformer架构中的注意力机制(Attention Mechanism)和多头自注意力使得模型能够理解复杂的上下文关系。Agent正是利用LLM的推理能力(Reasoning Capability)来实现任务分解和决策-49。

2. 函数调用(Function Calling / Tool Use)

函数调用是Agent能够“动手”的关键机制。大模型在生成文本时,可以同时输出结构化的函数调用指令(通常为JSON格式),指定要调用的函数名称和参数-32。系统接收到这个指令后执行实际函数,再将结果回传给模型。这一机制在OpenAI、Anthropic、Google Gemini等主流模型中均已原生支持。

3. ReAct框架(Reasoning + Acting)

ReAct框架是当前Agent设计的主流范式,它让Agent交替执行“思考”和“行动”,模拟人类“三思而后行”的行为模式-53。核心循环:观察(Observe)→ 推理(Reason)→ 行动(Act)→ 反馈(Feedback)→ 修正(Adjust) 。正是这一闭环让Agent具备了动态调整策略的能力。

4. 记忆管理(Memory Management)

记忆模块包括短期记忆(Short-term Memory,即对话上下文)和长期记忆(Long-term Memory,通常通过向量数据库实现)-21。长期记忆让Agent能够跨会话保持状态,像一个真正“在工作”的角色。

底层技术是为实现上层功能服务的“基础设施”。本文着重于理解概念和掌握使用,深入源码级别的解析将在后续进阶篇中展开。

七、高频面试题与参考答案

以下题目针对AI应用小助手相关技术岗位的面试高频考点,参考了2025-2026年的主流题库-49-53。

面试题1:什么是AI Agent?它与普通的大模型调用有何本质区别?

参考答案(踩分点标注):

定义要点:AI Agent(人工智能智能体)是具备自主决策与任务执行能力的智能系统,以大语言模型(LLM) 为认知核心,整合记忆、规划、工具调用能力-49。

核心区别(4个关键点):

状态性:普通LLM调用是无状态的(Stateless),Agent具备内部状态和记忆(Stateful)-53;

主动性:普通LLM被动响应,Agent可主动规划下一步行动(Proactive)-53;

工具使用:普通LLM只生成文本,Agent能调用外部API/函数执行操作(Tool Use)-53;

多步推理:普通LLM单次交互,Agent通过循环机制分解复杂任务(Multi-step Reasoning)-53。

面试题2:请解释ReAct框架的核心思想及其工作流程。

参考答案:

ReAct(Reasoning + Acting)是将推理和行动相结合的智能体范式,让Agent交替执行“思考”和“行动”,模拟人类“三思而后行”的行为模式-53。

工作流程四步循环:

推理:分析当前状态,决定下一步该做什么(输出自然语言推理链);

行动:执行具体动作(调用工具或生成回复);

观察:获取行动结果(工具返回值或用户反馈);

迭代:根据观察结果循环上述过程,直至任务完成-53。

优势:通过将内部推理过程外显化,极大提高任务执行的准确性和可解释性,有效减少模型幻觉。

面试题3:AI Agent的四大核心组件是什么?各负责什么功能?

参考答案:

可以用一个简洁公式概括:AI Agent = LLM + Memory + Planning + Tools-21

| 组件 | 英文 | 功能说明 |

|---|---|---|

| 大语言模型 | LLM | “大脑”,负责自然语言理解、推理与决策 |

| 记忆模块 | Memory | 包含短期记忆(对话上下文)和长期记忆(向量数据库存储的经验沉淀) |

| 规划模块 | Planning | 将模糊复杂任务分解为具体可执行的子任务序列 |

| 工具模块 | Tools | 通过函数调用(Function Calling)调用API、数据库、代码执行器等外部能力 |

补充要点:部分框架会将反馈(Reflection)作为第五个核心组件,负责评估行动结果并动态调整后续规划-21。

面试题4:什么是Function Calling(工具调用)?它在Agent中扮演什么角色?

参考答案:

定义:Function Calling是大模型根据用户请求或自身推理,结构化地声明需要调用的函数及其参数的能力-53。

角色定位:扮演Agent的 “手脚” ——将模型的语言理解能力与外部工具的确定性执行能力连接起来。模型负责“想”(决定做什么),执行器负责“做”(实际调用函数)。

标准流程(5步):

用户输入自然语言请求;

模型判断需要调用某个函数,生成结构化参数(JSON格式);

应用程序接收调用请求,实际执行该函数;

应用程序将执行结果返回给模型;

模型将结果总结后回复用户-53。

面试题5:AI Agent在实际生产环境中有哪些典型应用场景?

参考答案:

个人助理:OpenClaw等产品可实现自动订票、日程管理等个人事务-41;

办公协作:自动读取发票、登录ERP、填报销单,打通企业流程-2;

客户服务:AI Agent呼叫中心可自主处理投诉、补偿方案推荐,实测效率提升90%-;

金融领域:智能投资顾问同时考虑收益、风险、流动性,完成个性化投资组合推荐-2;

研发辅助:代码迁移、Bug修复等工程任务-。

八、结尾总结

核心知识点回顾

AI Agent的定义:以大语言模型为“大脑”,整合记忆、规划、工具能力的自主智能系统;

与AI助手的区别:AI助手是被动响应的“会说话的大脑”,Agent是主动执行的“数字员工”;

四大核心组件:LLM + Memory + Planning + Tools;

ReAct框架:推理与行动交替进行,形成“观察→推理→行动→反馈”的闭环;

底层技术支撑:LLM推理能力、Function Calling机制、ReAct范式、记忆管理;

面试核心考点:概念定义、与LLM的本质区别、ReAct流程、组件功能、工具调用机制。

重点与易错点提醒

| 易混淆点 | 正确理解 |

|---|---|

| Agent = 大模型? | ❌ 错误。Agent是大模型+记忆+规划+工具的组合体 |

| AI助手 = AI Agent? | ❌ 错误。AI助手是被动响应,Agent是主动执行 |

| ReAct = 只做推理? | ❌ 错误。ReAct是推理与行动交替进行的闭环 |

| 工具调用是模型执行的? | ❌ 错误。模型只输出调用指令,由应用程序实际执行 |

预告

本文为你系统梳理了AI应用小助手的核心概念与快速上手实践。下一篇将深入AI Agent的底层架构,包括Agent运行时的状态管理、多Agent协作模式(Multi-Agent Systems),以及如何在生产环境中部署和优化Agent应用。敬请期待!

📌 相关资源:

LangChain官方文档:https://docs.langchain.com

OpenAI Function Calling指南:https://platform.openai.com/docs/guides/function-calling

ReAct论文原文:https://arxiv.org/abs/2210.03629

本文首发于北京时间2026年4月10日,内容基于截至该日期的行业技术标准与公开资料编写。文中代码示例可在Python 3.10+环境中直接运行。