2026年,人工智能正从“对话框”全面迈向“智能体”时代,AI助手互动已不再是简单的问答对话,而是涵盖了自主决策、任务规划、工具调用与多轮执行的系统工程。AI Agent(AI智能体,简称Agent) 正成为连接大模型能力与产业应用的核心载体,预测显示2026年中国AI智能体市场规模将达111亿至135.3亿元,全球市场预计约175亿美元--2。本文将从技术痛点出发,系统拆解AI Agent的核心概念、经典架构、底层原理与高频面试考点,帮助读者建立从理论到实践的完整知识链路。

一、痛点切入:为什么传统LLM交互不够用了?

先看一个传统方式。假设你需要“帮我查一下北京今天的天气,然后写一份出行建议”。

传统纯LLM调用方式:

import openai response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": "帮我查一下北京今天天气,并写一份出行建议。"}] ) print(response.choices[0].message.content) 输出:模型会“猜”一个天气,或者直接告诉你它查不到实时天气

传统方式的三大痛点:

| 痛点 | 具体表现 |

|---|---|

| 信息过时 | LLM的训练数据有截止日期,无法获取实时信息(如今日天气、最新股价) |

| 行动力弱 | 只能输出文本,无法直接调用API、操作数据库或执行代码 |

| 复杂任务断裂 | 多步骤任务(查天气→规划路线→订票→发邮件)无法自主串联执行 |

正是这些局限,催生了具备感知—决策—执行闭环能力的AI Agent-1。Agent = LLM + Planning + Memory + Tool Use,这个公式已成为业界共识-51。

二、核心概念讲解:AI Agent

标准定义

AI Agent(AI智能体) 是一种能够自主感知环境、理解用户意图、进行逻辑推理与任务规划、调用工具完成目标,并具备自我迭代能力的AI系统-62。

关键词拆解

把AI Agent拆成四个字——“自主执行者”:

自主:无需人工干预即可完成流程

执行:不只是“说”,还要“做”

者:它是有“身份”和“能力边界”的执行单元

生活化类比

如果把LLM比作一个实习生,你问什么它答什么,但它不会主动查资料、不会打电话、不会动手操作电脑。

那么AI Agent就是正式员工——接到任务后,它会自己规划步骤:先去查资料、再调用工具、最后整理成报告提交给你。

核心特征(面试必记)

自主性:无需人工干预即可完成任务

规划能力:可拆解目标、制定执行步骤

工具调用:能使用、代码、API、数据库等外部能力

记忆能力:具备短期上下文记忆与长期经验记忆

反馈迭代:可根据执行结果修正行为、优化输出-62

三、关联概念讲解:Tool Use / Function Calling

标准定义

Function Calling(函数调用) 是大模型厂商通过微调或架构优化,赋予模型生成结构化指令(JSON格式)的能力,使模型能够精准匹配预定义函数并输出调用请求,而非依赖自然语言生成-35。

Tool Calling(工具调用) 则是Agent在推理过程中,选择并调用外部能力来完成任务——它不仅包含“怎么调用”,更包含“什么时候调、调哪个、调几次”的决策过程-39。

生活化类比

在传统方式下,你让LLM“调用天气API”,它可能会输出一段自然语言描述:“你可以去调用get_weather函数,参数city填北京”。这就像让一个不会用遥控器的朋友帮忙换台,他只能说“你按一下那个红色的键”。

Function Calling则相当于给LLM装上了“遥控器说明书”——模型直接输出 {“tool”: “get_weather”, “params”: {“city”: “北京”}} 这样的JSON指令,Agent框架直接执行,稳如老狗。

与AI Agent的关系

Tool Use / Function Calling 是Agent“做事”的底层机制(Execution Layer)

AI Agent 是包含决策、规划、记忆、反思的完整系统(System Level)

一句话总结:Tool Calling = Reasoning + Decision + Function Calling-39

四、概念关系与区别总结

| 对比维度 | AI Agent | Tool Use / Function Calling |

|---|---|---|

| 抽象层级 | 系统层(System) | 机制层(Mechanism) |

| 本质 | 自主决策与执行的完整系统 | 结构化输出与工具调用的技术机制 |

| 包含关系 | 包含规划、记忆、工具调用、反思 | 是Agent的工具调用能力的一种实现 |

| 类比 | 一家公司的CEO | CEO手里的Excel公式 |

| 核心能力 | 知道“要不要做、做什么、怎么做” | 知道“怎么把‘做’的指令写出来” |

一句话记忆:AI Agent是大脑,Tool Use是手臂——没有手臂的大脑寸步难行,没有大脑的手臂不过是机械重复。

五、代码/流程示例演示

极简Agent示例:带工具调用的智能助手

以下示例演示一个最简化的AI Agent——它能自主判断是否需要调用工具、生成调用指令、执行工具并整合结果。

import json import requests Step 1: 定义工具(Tools定义) TOOLS = [ { "type": "function", "function": { "name": "get_weather", "description": "获取指定城市的实时天气信息", "parameters": { "type": "object", "properties": { "city": {"type": "string", "description": "城市名称,如'北京'"} }, "required": ["city"] } } } ] Step 2: 定义工具的真实执行函数 def execute_tool(tool_name, params): if tool_name == "get_weather": city = params["city"] 模拟真实API调用(实际开发中替换为真实天气API) return {"city": city, "temperature": "22°C", "condition": "晴", "humidity": "45%"} Step 3: Agent的核心循环(ReAct模式的极简实现) def agent_loop(user_query, llm, tools): 第一轮:模型决定是否需要调用工具 response = llm.chat_with_tools(user_query, tools) 如果模型输出了tool_calls,则执行工具 if response.tool_calls: results = [] for tc in response.tool_calls: tool_result = execute_tool(tc.function.name, json.loads(tc.function.arguments)) results.append(tool_result) 第二轮:将工具执行结果喂给模型,生成最终答案 final_response = llm.chat_with_context(user_query, results) return final_response.content 如果模型认为不需要工具,直接返回 return response.content 执行示例 result = agent_loop("帮我查一下北京的天气,并根据天气给出穿衣建议", llm_model, TOOLS) print(result)

执行流程解析

用户输入 → LLM推理(判断是否需要工具)→ 生成JSON调用指令 → Agent执行工具 → 获取结果 → LLM整合 → 输出最终答案这就是经典的ReAct(Reasoning + Acting)模式,它打破了传统LLM“输入→输出”的线性局限,形成了“思考—行动—观察”的闭环-34。

六、底层原理/技术支撑

AI Agent之所以能够自主决策和执行,底层依赖三大技术支柱:

1. 大模型推理引擎(LLM as the Brain)

Agent的“智能”本质来源于大语言模型(Large Language Model, LLM) 的推理能力。LLM通过海量数据预训练,掌握了世界知识、逻辑推理和语义理解能力,构成了Agent的决策中枢。

2. Function Calling / 结构化输出机制

这是Agent“动手”的关键技术。各大模型厂商通过微调或架构优化,使模型能够输出符合JSON Schema的结构化调用请求,而非自由文本-39。OpenAI于2023年率先提出,随后Anthropic、Google、国产大模型迅速跟进,目前Function Calling已是所有主流大模型的标配能力-。

3. 规划与记忆模块(Planning & Memory)

规划:通过思维链(Chain-of-Thought, CoT) 、任务分解(Task Decomposition) 等技术,Agent能够将模糊目标拆解为可执行的子任务序列-51

记忆:通过检索增强生成(Retrieval-Augmented Generation, RAG) 与长短期记忆结合,Agent能记住历史交互和领域知识-51

💡 进阶预告:当前主流Agent架构已演进至五层——逻辑编排层、多智能体协作层、底层协议层等,这部分将在后续文章中详细拆解-。

七、高频面试题与参考答案

题1:请解释什么是AI Agent?它与传统LLM有什么区别?

标准答案框架(3层递进)

第一层(概念定义) :AI Agent是一种能够自主感知环境、理解意图、进行逻辑推理与任务规划、调用工具完成目标,并具备自我迭代能力的AI系统-62。

第二层(核心差异) :传统LLM是“文本生成器”——根据输入预测下一个字,只能输出文本;AI Agent是“行动执行者”——具备自主性、规划能力、工具调用、记忆和反馈迭代五大特征。

第三层(公式总结) :Agent = LLM + Planning + Memory + Tool Use-51。

踩分点:必须答出“自主性”“工具调用”“记忆”“规划”四个关键词。

题2:Function Calling和Tool Calling有什么区别?

标准答案框架

第一层(本质结论) :两者底层机制几乎相同,差异主要来自命名和抽象层级-39。

第二层(核心区别) :

Function Calling(OpenAI提出)聚焦于机制层——解决“怎么调用”的问题,输出结构化JSON

Tool Calling(Anthropic等)聚焦于系统层——解决“什么时候调、调哪个、调几次”的问题,是Agent能力编排的体现-39

第三层(总结记忆) :Tool Calling = Reasoning + Decision + Function Calling-39。

踩分点:必须区分“机制”与“能力”两个抽象层级。

题3:AI Agent的经典架构包含哪些模块?

标准答案框架

工业界通用的AI Agent架构包含五大核心模块-62:

感知与意图理解层:解析用户需求,明确任务目标

记忆模块:短期上下文记忆 + 长期知识库 + 经验库

推理与决策层:基于大模型做逻辑判断、任务拆解、步骤规划

执行与工具调用层:调用代码、、插件、API、RAG等能力

反馈与优化层:判断执行结果是否达标,失败则自动重试、修正逻辑

踩分点:五大模块缺一不可,最好能用“感知→记忆→推理→执行→反馈”的流程串起来回答。

题4:Agent的典型工作模式有哪些?

标准答案框架

吴恩达总结了Agent的四种核心设计模式-:

反思模式(Reflection) :Agent对自己的输出进行检查和修正

工具调用模式(Tool Use) :Agent调用外部工具完成特定操作

规划设计模式(Planning) :Agent将大目标拆解为可执行的子任务

多智能体协作模式(Multi-Agent) :多个Agent各司其职、协同完成任务

踩分点:四种模式都需要能举例说明。

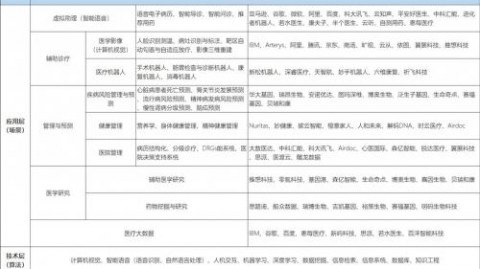

题5:企业在哪些场景落地AI Agent?

标准答案框架-62

| 场景类型 | 典型应用 |

|---|---|

| 智能客服/售后 | 自动意图识别 + 多轮对话 + 工单处理 + 知识库问答 |

| 数据分析 | 自动读取数据、生成SQL、绘制图表、输出分析报告 |

| RAG+知识库 | 企业文档、政策、产品库的精准问答与总结 |

| 代码开发/运维 | 自动生成代码、排查Bug、执行脚本、监控告警 |

| 内容创作 | 文案生成、标题优化、素材整理、发布策略建议 |

踩分点:能结合具体业务场景说明,而非泛泛而谈。

八、结尾总结

全文核心回顾

| 板块 | 核心要点 |

|---|---|

| 痛点认知 | 传统LLM缺实时性、缺行动力、缺任务串联能力 |

| AI Agent定义 | 自主感知→推理规划→调用工具→记忆迭代的完整系统 |

| 核心公式 | Agent = LLM + Planning + Memory + Tool Use |

| 工具调用机制 | Function Calling是“怎么调用”,Tool Calling是“何时+调什么+调几次” |

| 底层依赖 | LLM推理引擎 + Function Calling + 规划记忆模块 |

| 面试高频题 | 概念定义、架构模块、Function Calling vs Tool Calling、工作模式、落地场景 |

重点提醒

⚠️ 易混淆:不要把AI Agent和单纯的LLM API调用混为一谈——Agent的核心在于“自主决策+闭环反馈”,而非“一问一答”

⚠️ 必记公式:Agent = LLM + Planning + Memory + Tool Use

⚠️ 面试踩分点:务必答出“自主性”“工具调用”“记忆”“规划”四个核心特征

下一篇预告

本文重点讲解了AI Agent的概念、架构与工具调用机制。下一篇我们将深入实战——手把手搭建一个带完整工具的AI智能体,涵盖LangChain框架实战、多轮对话设计、以及企业级RAG+Agent的集成方案,敬请期待。